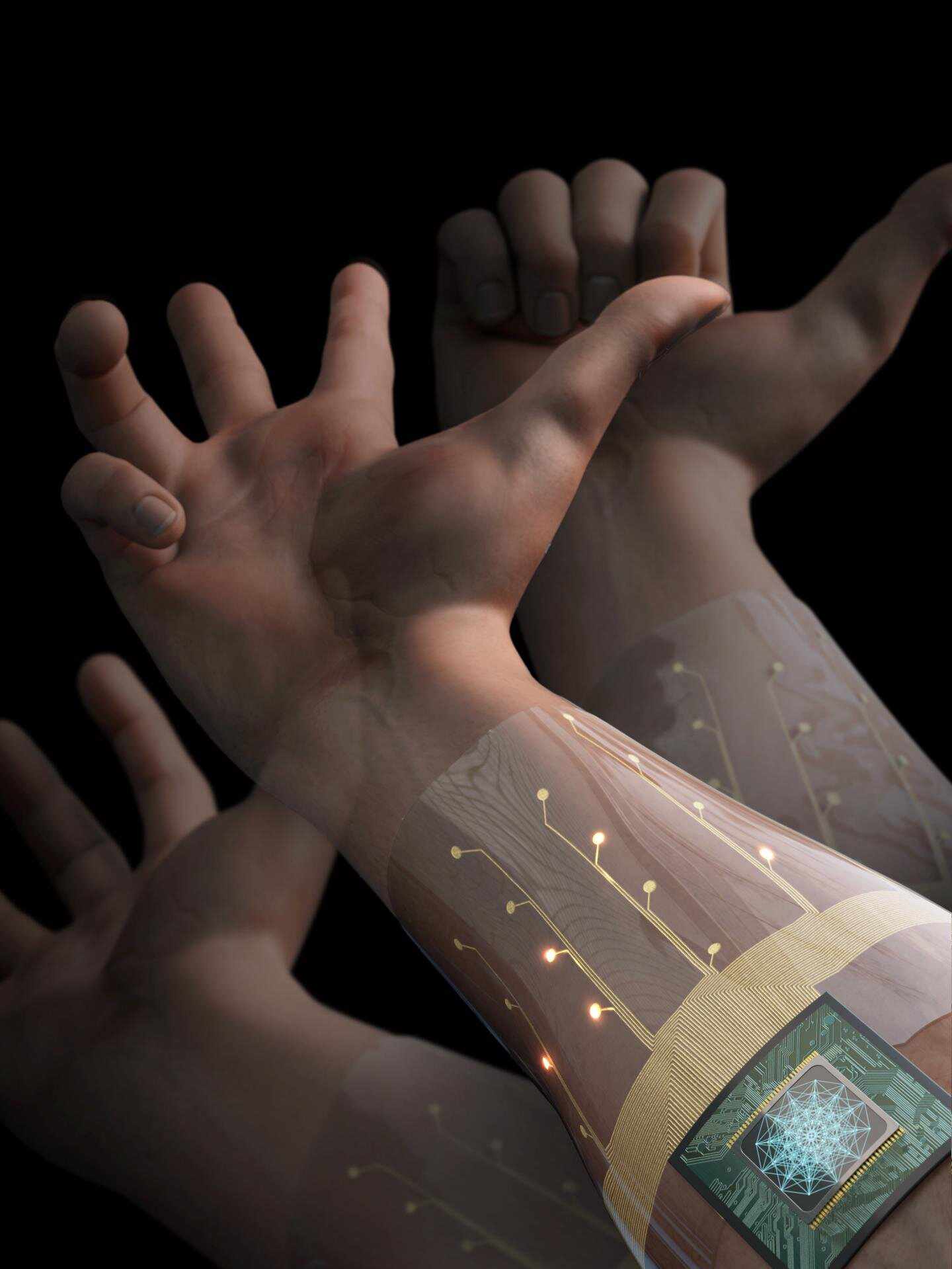

Ingenieure der University of California am Standort Berkeley greifen mit einem neuen Gerät zur Gestenerkennung elektrische Signale des Gehirns zur Bewegung der Hände am Unterarm ab. Damit lässt sich ein Computer ohne Tastatur bedienen, Videospiele ohne Controler spielen und Autos ohne Lenkrad fahren, versprechen die Entwickler.

64 Stellen

Ali Moin, der das System als Doktorand mit Ana Arias, Professorin für Elektrotechnik, entwickelt hat, denkt vor allem an die Steuerung von Prothesen. Grundsätzlich lasse sich die Technik zur Interaktion mit jedem elektronischen Gerät nutzen.

„Prothetik ist eine wichtige Anwendung dieser Technologie, bietet aber auch eine sehr intuitive Möglichkeit zur Kommunikation mit Computern“, sagt Moin.

Die Steuerung von Geräten und Prothesen mit Gesten lasse sich zwar auch auf andere Art realisieren, etwa mit einer Kamera. Doch sein Verfahren sei eleganter und einfacher umzusetzen. Der Sensor ist ein flexibles Armband, mit dem die elektrischen Signale an 64 Stellen des Unterarms registriert werden. Sie werden von einem Prozessor ausgewertet, dessen Software auf Künstlicher Intelligenz basiert, und in Steuerbefehle für Geräte und Prothesen umgesetzt. Nach einer Trainingsphase konnte das System 21 verschiedene Gesten eindeutig erkennen, darunter Daumen hoch, eine Faust, Bewegungen einzelner Finger sowie die flache Hand.

Verbesserung durch Training

Da die Signale individuell unterschiedlich sind, muss sich das System durch Training auf seinen Nutzer einstellen. Andererseits lässt die eingesetzte Software ein selbstständiges Lernen zu. Wenn sich beispielsweise die mit einer bestimmten Handbewegung verbundenen elektrischen Signale ändern, weil der Arm eines Benutzers verschwitzt ist oder er seinen Arm über den Kopf hebt, könne der Algorithmus diese neuen Infos in Moins Modell aufnehmen.

Die meisten der eingesetzten Techniken gibt es laut Donald O. Pedersen, Professor für Elektrotechnik und Chef des Entwickler-Teams, schon. Einzigartig sei, die Bio-Sensorik, Signalverarbeitung und -auswertung sowie Künstliche Intelligenz in ein geschlossenes System integriert werden konnten, dass klein und flexibel ist und wenig Strom verbraucht.